近年来,基于海量无监督文本的深度神经网络预训练模型大幅提升了各个 NLP 基准任务的效果。

2019 年,适合中国开发者的百度开源深度学习平台飞桨()发布了持续学习语义理解框架艾尼(ERNIE),ERNIE 是利用百度海量数据和飞桨多机多卡高效训练优势,通过深度神经网络与多任务学习等技术,持续学习海量数据和知识。基于该框架的 ERNIE 预训练模型,已累计学习 10 亿多知识,适用于各种 NLP 应用场景,效果提升明显,使用高效、便捷。

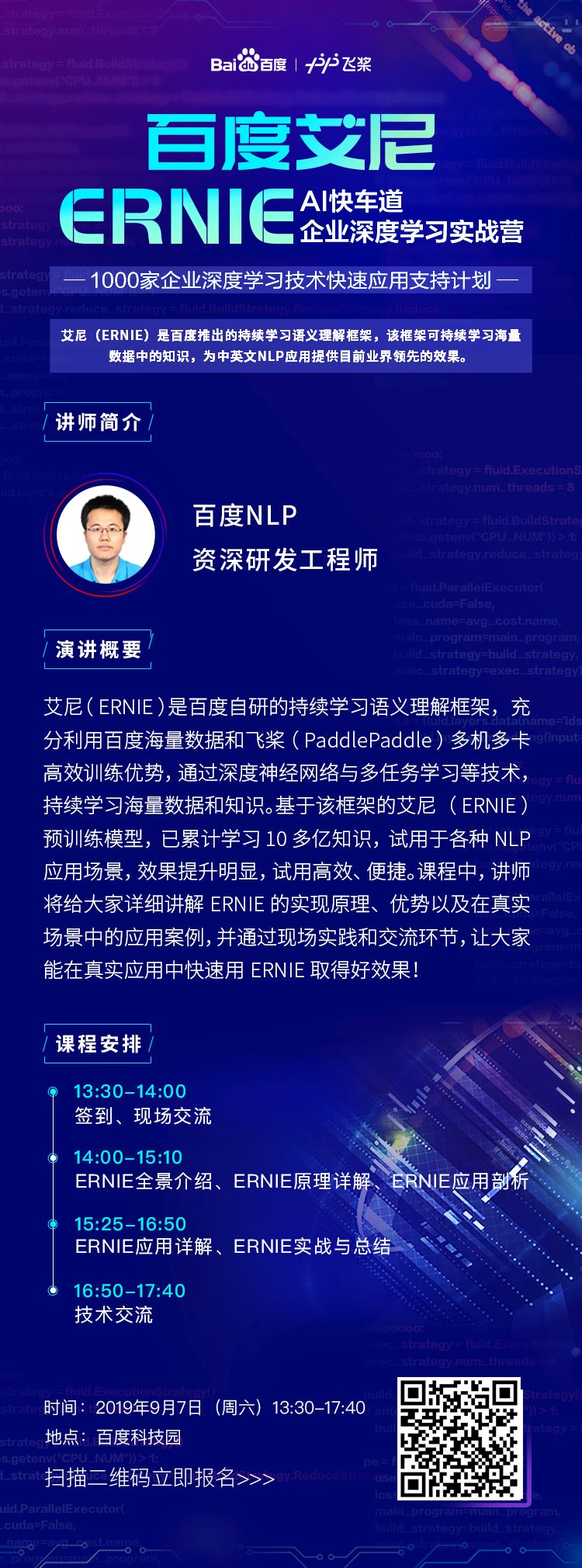

9 月 7 日,百度 AI 快车道——百度艾尼(ERNIE)专场首站北京,课程将围绕持续学习语义理解框架 ERNIE 的详解和实战应用进行。来自百度的明星讲师,将给大家详细讲解 ERNIE 的实现原理、优势以及在真实场景中的应用案例,并通过现场实践和交流环节,让大家能在真实应用中快速用 ERNIE 取得更好效果!

![图片[1] | 中文任务全面超BERT,NLP无监督预训练模型ERNIE真有官方说的那么好? | 星尘资源网](/wp-content/uploads/2025/10/1760450720998_0.jpg)

百度艾尼(ERNIE)的核心优势

优势一:任务效果领先

业内领先的语义理解预训练模型,刷新多个中英文 NLP 基础任务、应用任务的效果

优势二:少量样本快捷训练

少量训练数据即可达到良好效果,训练便捷,效果提升迅速

优势三:多种方案高效预测

支持多倍效果无损压缩,并有多种性能优化方案以满足应用需求

优势四:中文场景技术服务

完善的中文应用场景技术服务支持,产业 NLP 应用实践持续锤炼

![图片[2] | 中文任务全面超BERT,NLP无监督预训练模型ERNIE真有官方说的那么好? | 星尘资源网](/wp-content/uploads/2025/10/1760450720998_1.jpg)

持续学习语义理解框架 ERNIE

干货满满的现场,行业 A 级的导师,还有一群志同道合的小伙伴,还在等什么?活动限额免费 30 人!赶快扫描下方二维码或者点击 阅读原文 报名参加吧!

![图片[3] | 中文任务全面超BERT,NLP无监督预训练模型ERNIE真有官方说的那么好? | 星尘资源网](/wp-content/uploads/2025/10/1760450720998_2.png)

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END

请登录后查看评论内容